Wenn die Cloud keine Option ist

Es gibt Unternehmen, für die ist ein API-Call an einen Cloud-Anbieter keine Frage der Kosten oder der Qualität. Es ist schlicht nicht erlaubt. DSGVO-Anforderungen, NDA-geschützte Konstruktionsdaten, branchenspezifische Regulierung — Daten, die das Haus nicht verlassen dürfen.

Für genau diese Situation haben wir den dritten Teil unserer KI-Seminarreihe konzipiert: "Lokale Inference ohne API."

Was wir gezeigt haben

Lokale KI-Inference bedeutet: Das Sprachmodell läuft auf dem eigenen Rechner oder im eigenen Rechenzentrum. Keine Daten fließen nach außen. Open-Source-Modelle im Container, GPU-Beschleunigung wo vorhanden, eine lokale Benutzeroberfläche.

Ein Befehl und das Modell läuft. Technisch ist die Einstiegshürde erstaunlich niedrig.

Die eigentliche Hürde

Die Teilnehmer kamen mit Firmen-Laptops. Gesperrte Admin-Rechte, Proxy-Konfigurationen die Container-Downloads blockieren, IT-Richtlinien die Container-Technologie als Sicherheitsrisiko einstufen.

Die Technik ist bereit. Die Modelle sind gut genug. Aber zwischen einem funktionierenden Experiment auf dem privaten Rechner und einem produktiven Einsatz im Unternehmen liegt eine organisatorische Lücke, die kein besseres Modell schließen kann.

Von Container zu Kubernetes

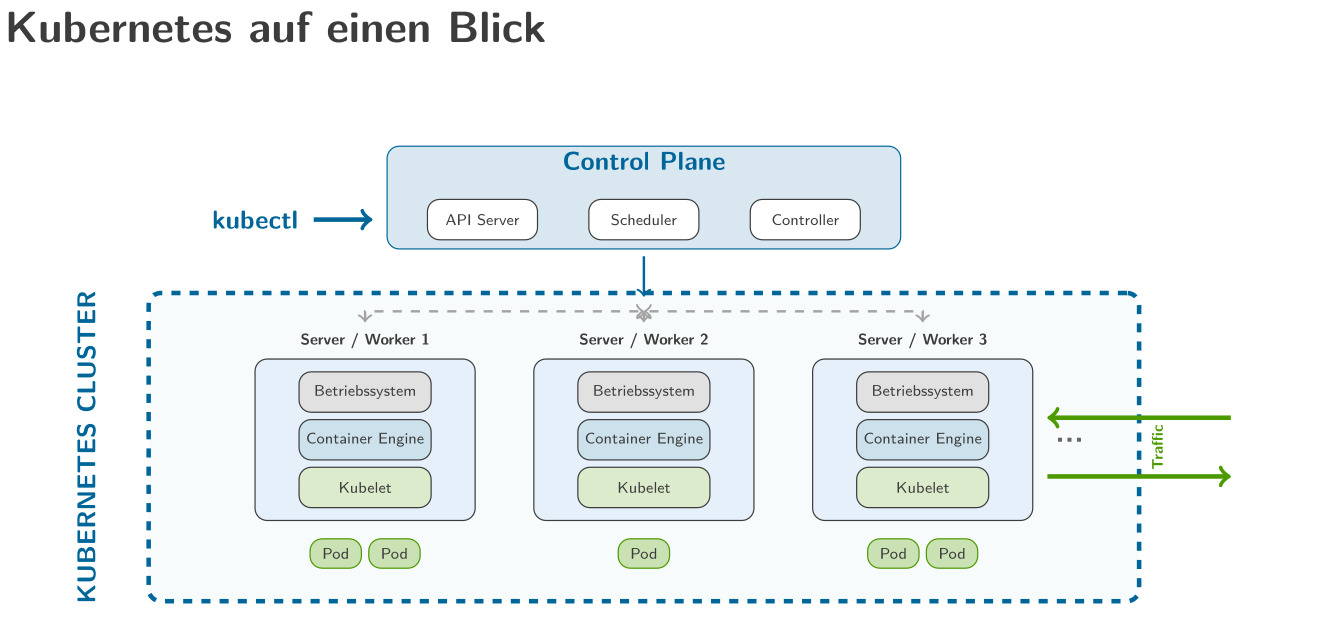

Lokale Inference auf einem Laptop ist ein Anfang. Für den produktiven Einsatz braucht man mehr: Container-Orchestrierung, Ressourcen-Management, Health Checks, automatische Restarts.

In Teil 4 der Seminarreihe ging es deshalb um Kubernetes — das gleiche System, mit dem wir unsere eigene KI-Plattform betreiben. Die Teilnehmer sahen, wie man von einem einzelnen Container zu einer skalierbaren Infrastruktur kommt.

Wachsendes Interesse

Das Thema Datensouveränität trifft einen Nerv. Mittlerweile wurden wir auch angefragt, die Seminare für Personal aus der medizinischen Forschung zu halten — ein Bereich, in dem der Schutz sensibler Daten besonders kritisch ist.

Fazit: Lokale KI wird nicht durch bessere Modelle mainstream. Sie wird es durch einfachere Installation — und durch IT-Abteilungen, die Container nicht als Bedrohung sehen, sondern als Werkzeug.